ALGUNOS TEXTOS FUERON TOMADOS DE LA PUBLICACION DE LA ORGANIZACIÓN MUNDIAL DE LA SALUD “ETICA Y GOBERNANZA DE LA INTELIGENCIA ARTIFICIAL PARA LA SALUD”

La medicina siempre ha avanzado de la mano de la tecnología. Sin embargo, el ritmo acelerado de las nuevas tecnologías digitales, y particularmente de la Inteligencia Artificial (IA), junto con la telemedicina y el manejo masivo de datos ha abierto interrogantes éticos que desafían los principios clásicos de la práctica médica.

Todos los algoritmos deben probarse rigurosamente en los entornos en los que se utilizará la tecnología para garantizar que cumplan con los estándares de seguridad y eficacia. El examen y la validación deben incluir las suposiciones, los protocolos operativos, las propiedades de los datos y las decisiones sobre los resultados de la tecnología de IA. Las pruebas y evaluaciones deben ser periódicas, transparentes y lo suficientemente exhaustivas como para abarcar las diferencias en el rendimiento del algoritmo en función de la raza, la etnia, el género, la edad y otras características humanas relevantes.

Debe existir una supervisión sólida e independiente de dichas pruebas y evaluaciones para garantizar que se realicen de forma segura y eficaz.

Las instituciones sanitarias, los sistemas de salud y las agencias de salud pública deben publicar periódicamente información sobre cómo se han tomado las decisiones para la adopción de una tecnología de IA y cómo se evaluará periódicamente, sus usos, sus limitaciones conocidas y la función de la toma de decisiones, lo que puede acilitar la auditoría y la supervisión externas.

Estas prácticas pueden garantizar que un profesional clínico pueda anular las decisiones tomadas por los sistemas de IA y que la autonomía de las máquinas pueda restringirse y hacerse intrínsecamente reversible.

El respeto a la autonomía también implica los deberes conexos de proteger la privacidad y la confidencialidad, así como de garantizar un consentimiento informado y válido mediante la adopción de marcos legales adecuados para la protección de datos.

Estos deben ser plenamente respaldados y aplicados por los gobiernos y respetados por las empresas, sus diseñadores de sistemas, programadores, creadores de bases de datos y otros. Las tecnologías de IA no deben utilizarse para la experimentación ni la manipulación de seres humanos en un sistema de atención médica sin un consentimiento informado válido.

El uso de algoritmos de aprendizaje automático en el diagnóstico, el pronóstico y los planes de tratamiento debe incorporarse al proceso para obtener un consentimiento informado y válido. Los servicios esenciales no deben limitarse ni denegarse si una persona niega su consentimiento, y ni el gobierno ni entidades privadas deben ofrecer incentivos o incentivos adicionales a quienes sí lo den.

Las leyes de protección de datos son un medio para salvaguardar los derechos individuales e imponen obligaciones a los responsables y encargados del tratamiento de datos. Estas leyes son necesarias para proteger la privacidad y la confidencialidad de los datos de los pacientes y para establecer el control de los pacientes sobre sus datos. En sentido amplio, las leyes de protección de datos también deberían facilitar a las personas el acceso a sus propios datos de salud y su transferencia o intercambio a su gusto.

Dado que el aprendizaje automático requiere grandes cantidades de datos (big data), estas leyes son cada vez más importantes.

Promover el bienestar humano, la seguridad humana y el interés público.

Las tecnologías de IA no deben causar daños a las personas. Deben cumplir con los requisitos regulatorios de seguridad, precisión y eficacia antes de su implementación, y deben implementarse medidas para garantizar el control y la mejora de la calidad.

Por lo tanto, los financiadores, desarrolladores y usuarios tienen el deber continuo de medir y monitorear el rendimiento de los algoritmos de IA para garantizar que las tecnologías funcionen según lo diseñado y evaluar si tienen algún impacto negativo en pacientes individuales o grupos.

La prevención de daños requiere que el uso de tecnologías de IA no provoque daños mentales o físicos.

Las tecnologías de IA que proporcionan un diagnóstico o una advertencia que una persona no puede abordar debido a la falta de atención médica adecuada, accesible o asequible deben gestionarse cuidadosamente y sopesarse con cualquier deber de advertir que pueda surgir de hallazgos incidentales o de otro tipo, y deben implementarse las salvaguardias adecuadas para proteger a las personas de la estigmatización o la discriminación debido a su estado de salud.

Refuerzan la vacunación contra el virus respiratorio en embarazadas en Artigas

Salud Pública desplegará operativo preventivo integral para un Carnaval seguro en Artigas

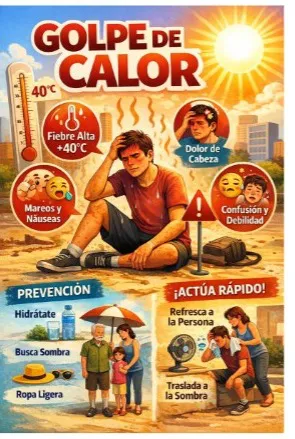

Golpe de calor: Una urgencia prevenible que puede poner en riesgo la vida

Elecciones en el Sunca: Martínicorena llama a la unidad y defiende la gestión

Plazo para postularse a becas del Fondo de Solidaridad finaliza el 28 de febrero

Hogar de Ancianos de Artigas recibió importante donación

Festival criollo solidario en el Fogón de los Gauchos a beneficio de jinete lesionado