ALGUNOS TEXTOS FUERON TOMADOS DE LA PUBLICACION DE LA ORGANIZACIÓN MUNDIAL DE LA SALUD

“ETICA Y GOBERNANZA DE LA INTELIGENCIA ARTIFICIAL PARA LA SALUD”

La medicina siempre ha avanzado de la mano, y en muchos casos, gracias al avance de la tecnología. Sin embargo, el ritmo acelerado de las nuevas tecnologías digitales, y particularmente de la Inteligencia Artificial (IA), junto con la telemedicina y el manejo masivo de datos ha abierto interrogantes éticos que desafían los principios clásicos de la práctica médica.

¿Inteligencia Artificial es una herramienta o el final de las decisiones?

La IA aparece como una herramienta capaz de mejorar los diagnósticos, optimizar tratamientos, reducir errores, pero también plantea algoritmos capaces de analizar imágenes, reducir riesgos y sugerir conductas. Todo esto plantea el dilema de si la IA será una parte importante del camino o será “todo” el camino.

El dilema surge cuando la decisión medica pasa del profesional al sistema de IA, y se generan algunos dilemas éticos. Es así que la Organización Mundial de la Salud (OMS)ha identificado los siguientes problemas, y muchos de ellos aun sin solución.

Responsabilidad: ¿si un algoritmo de IA se equivoca, quien responde? ¿El médico?, ¿el fabricante?, ¿la institución?

El uso de tecnologías de IA en medicina requiere la atribución de responsabilidad dentro de sistemas complejos donde la responsabilidad se distribuye entre numerosos agentes. Cuando las decisiones médicas tomadas mediante tecnologías de IA se equivocan y perjudican a las personas, los procesos de responsabilidad y rendición de cuentas deben identificar claramente el papel relativo de los fabricantes y los usuarios clínicos en el daño. Este es un desafío en constante evolución y sigue sin resolverse en las leyes de la mayoría de los países. Las instituciones no solo tienen responsabilidad legal, sino también el deber de asumir la responsabilidad de las decisiones tomadas por los algoritmos que utilizan, incluso si no es factible explicar en detalle cómo estos algoritmos producen sus resultados.

Transparencia o razonamiento. Muchos algoritmos funcionan sin desarrollar el pensamiento clínico de cómo se llega a una conclusión.

La OMS plantea como condición para utilizar adecuadamente la IA, garantizar la transparencia, la comprensión y la inteligibilidad.

La IA debe ser inteligible o comprensible para fabricantes, usuarios y organismos reguladores, así como para los profesionales que la utilizan.

Dos enfoques generales para garantizar la inteligibilidad son mejorar la transparencia y la explicabilidad de la tecnología de IA.

La transparencia exige que se publique o documente suficiente información (descrita a

continuación) antes del diseño e implementación de una tecnología de IA. Dicha información debe facilitar una consulta pública significativa y un debate sobre cómo se diseña la tecnología de IA y cómo debe utilizarse. Dicha información debe seguir publicándose y documentándose de forma regular y oportuna tras la aprobación de una tecnología de IA para su uso.

La transparencia mejorará la calidad del sistema y protegerá la seguridad de los pacientes y la salud pública. Por ejemplo, los evaluadores del sistema requieren ransparencia para identificar errores, y los reguladores gubernamentales dependen de ella para llevar a cabo una supervisión adecuada y eficaz.

Debe ser posible auditar una tecnología de IA, incluso si algo falla. La transparencia debe incluir información precisa sobre los supuestos y las limitaciones de la tecnología, los protocolos operativos, las propiedades de los datos (incluidos los métodos de recopilación, procesamiento y etiquetado de datos) y el desarrollo del modelo algorítmico utilizado.

Las tecnologías de IA deben ser explicables en la medida de lo posible y según la capacidad de quienes las reciben. Las leyes de protección de datos ya establecen obligaciones específicas de explicabilidad para la toma de decisiones automatizada.

Quienes soliciten o requieran una explicación deben estar bien informados, y la información educativa debe adaptarse a cada población, incluyendo, por ejemplo, a las poblaciones marginadas. Muchas tecnologías de IA son complejas, y esta complejidad puede frustrar tanto a quien la explica como a quien la recibe. Existe un posible equilibrio entre la explicabilidad completa de un algoritmo (a costa de la precisión) y una mayor precisión (a costa de la explicabilidad).

Continua en próximas entregas.

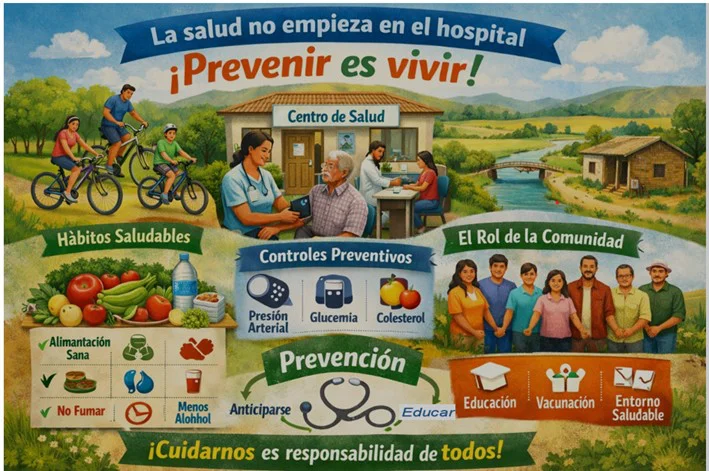

Artigas intensifica la campaña de vacunación antigripal con foco en población de riesgo

Comenzó la campaña de vacunación antigripal en Artigas

Uruguay inicia la campaña de vacunación antigripal con 600.000 dosis gratuitas

Los peligros ocultos de los energizantes en niños y adolescentes en Uruguay

Edición del diario a papel correspondiente al día 23-03-2026

Comienza el clima de las 500 Millas del Norte: más de 130 ciclistas se preparan

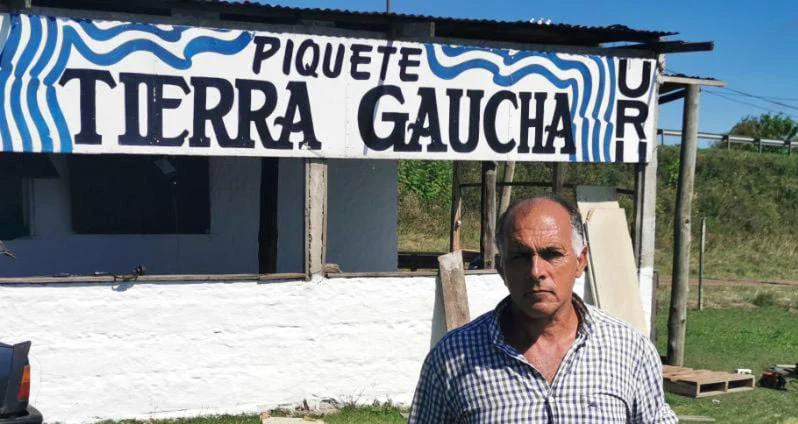

Tierra Gaucha se prepara para cuatro días de jineteadas y tradición en Artigas

Suba de combustibles genera preocupación en Artigas y advierten posible nuevo aumento en mayo